ChatGPTにはじまる生成AIの波

国内外問わず、ChatGPTを中心に生成AIの波が止まりません。これらは、パブリッククラウドとして提供され、無料で使うことができ、個人においても利用のハードルが非常に低くなっています。

生成AI利用のリスクを考える

WalkMeのお客様と会話していても、どのお客様でも生成AIが社内のキーワードとなり、活用方法や、利用方法の議論がなされていると伺います。

筆者も御多分に洩れず、ChatGPTを活用して、さまざまな場面で活用し生産性の向上に役立てています。特に、文章を英語から日本語へ、日本語から英語への翻訳に役立てたり、また、筆者自身は開発者ではないため、たまにしか行わないプログラミングにおいても、プログラムコードを簡単に生成してくれるのも非常に助けとなっています(もちろんコード生成後のテストは行いますが(汗))。

<シャドーAIとは?>

WalkMeでは生成AIに限らず、Webサービスとして提供されているAIツールのうち、企業側が把握していない従業員が利用する(利用してしまっている)AIツールをシャドーAIと定義しています。

ニュースなどでも話題になりますが、生成AI、AIサービスの利用のセキュリティ観点でのリスクはどんなものがあるでしょうか?せっかくなので、ChatGPTに聞いてみると、こんな回答が返ってきます。

以下はWalkMeワークステーションに統合されたChatGPTを利用した回答例です。

<ChatGPTの回答>

AIのセキュリティリスクには、以下のようなものがあります。

– 生成AIは人工的に作り出されたものであり、その背後には人間の偏見や差別などの意図がある可能性があるため、不公平な結果が生じるリスクがある。

– 生成AIが多数のデータを学習することによって、そのデータを含む個人情報が漏洩するリスクがある。

– 攻撃者が生成AIを悪用して、偽の情報やフェイクニュースを作り出すことができるため、社会的な混乱を引き起こすリスクがある。

– 生成AIが誤った情報を生成することによって、企業や個人の評判を損ねるリスクがある。

– 生成AIが人間の言語や行動を模倣することができるため、フィッシング攻撃や詐欺行為などのセキュリティ上のリスクがある。

以上が、ChatGPTが回答した、生成AIのセキュリティリスクの例です(質問の仕方により回答内容は変わってきます)。この中でも、”情報漏洩”は特に企業利用としては、非常に気になるリスクではないでしょうか。もちろん、利用企業はこれらのリスクを把握し、それらに対処するための適切な対策を講じる必要があります。

その生成AI、シャドーAIになってませんか?

当然リスクを最小限に抑えるため、生成AIの利用をルールとして禁止する、または企業によっては生成AIへのアクセスを遮断する、などの対策を取られるケースはあると思います。それらを、ルールとして利用禁止したとして、”従業員が本当に使っていない”と言い切れるでしょうか?

その生成AI、実はシャドーAIになっていませんか?

では、このようなシャドーAIの従業員の利用状況を皆様はどのように見つけ、把握しますか?膨大なネットワークログを収集し、検索や集計をかけて把握しますか?AIツールに限らず、アクセスログやネットワークログから、誰がいつ使っていて、どのくらいの頻度利用しているのかを、正しく理解することは簡単にできますでしょうか。仮になんとかできたとしても、そこから先のアクションに繋げることはできますでしょうか?

シャドーAIを検出可能なWalkMeのデジタルアダプション

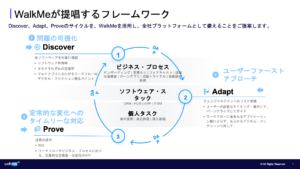

WalkMeのデジタルアダプションでは、ユーザーの行動データを元にしたデータドリブンのアプローチを行い、分析結果を元にシステム導入者側の意図を載せた上で、エンドユーザーが望んているタイミングと場面でユーザーに寄り添うようなコンテンツを作成・提供することができます。

エンドユーザーが利用した後は、さらに分析し、改善をしたコンテンツを作成し・・・と言うように、PDCAサイクルを回すことができる唯一のデジタルアダプションプラットフォームがWalkMeです。

さらに、WalkMeでは、ユーザーの行動データの観点で、Discovery(ディスカバリー)と言う、”Webアプリケーションの利用状況検出・集計機能”をリリースしております。

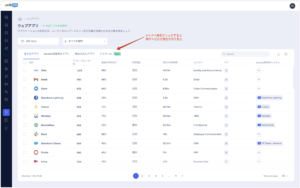

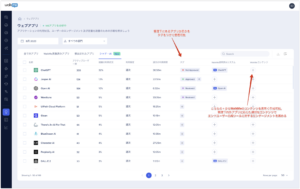

Discoveryでは、ユーザーがどのWebアプリケーションを、どのくらい(滞在時間)、どの程度(利用頻度)利用しているかを収集し、収集したデータをダッシュボードとしてIT部門やCIOが見やすい形で可視化し提供されます。さらに、部門情報を入れることで、どの部門でどのくらいどの程度、と言う観点でも把握することができます。

ここで、シャドーAIです。Disoveryの機能には、シャドーAIを検出する機能を設けております。CIOやIT部門は、企業側が想定していない・許可していないAIツールを従業員が利用しているかどうかが、データとして可視化され確認することができます。多種多様なネットワークのログを集計し、面倒な計算をする必要はありません。

シャドーAIを検出して終わりではない。AI利用促進は企業の成長に欠かせない重要なピース。

では、シャドーAIを検出することができました。利用禁止のAIの通信を遮断しました。果たしてそれで終わって良いでしょうか?AIの活用・生成AIの活用は企業の成長には必要となっていますが、セキュリティの懸念から、オープンなChatGPTの利用は禁止し、会社専用のChatGPTテナント生成AIテナント(例えばAzure Open AI serviceなど)を利用するケースも増えています。

つまり、セキュリティの懸念を排除した上で生成AIを活用することは、競争に打ち勝ち、自社を成長・発展させるためには絶対必要な条件と言えるのです。

そこで、再度WalkMeのデジタルアダプションです。WalkMeのデジタルアダプションは、企業のWebアプリケーションの利活用を促進し最大の効果を発揮させ、企業の売り上げや成長を後押しする価値あるソリューションです。

AIツールのコンプライアンス徹底及び利用率向上のためのWalkMeユースケース

具体例でお話ししましょう。オープンのChatGPTにアクセスしたユーザーにアラートを出し利用ルールを案内し、自社のセキュアな生成AIツールにユーザーを誘導するケースを想定してみてください。

わかりやすい注意メッセージを示すことで、未然に情報漏洩の危険を啓蒙し、且つ、正しいサイトへの誘導で従業員も安心して利用することができます。

次の例では、生成AIツールの利用が十分ではない、または、自社管理下の生成AIツールを認知していないユーザーへの利活用促進の例です。

WalkMeワークステーションの通知機能を利用し、プロアクティブにデスクトップ通知を表示することで、自社管理下の生成AIツールの認知度と利用向上を期待できます。

Video Player

さいごに

本ブログでは、セキュリティのリスクとなりうるシャドーAIの利用をWalkMeの機能を利用して把握し、WalkMeのコンテンツを利用することで、本来利用すべきAIツールの利用促進を加速し企業成長に繋げることができることを、ユースケースを交えてご説明しました。

WalkMeを利用することで、クラウド/パブリッククラウドの観点では、AIに限らず、あらゆるWebアプリケーションの、利用状況の可視化、ユーザーの利用促進、ユーザー満足度向上に繋げていくことが可能となります。